Qu’est-ce que la transparence de l’IA ? Le guide ultime

La transparence de l’IA permet d’instaurer la confiance, de garantir l’équité et de se conformer aux réglementations. Découvrez les avantages et les défis de sa mise en place, et les stratégies à suivre pour réussir.

Par Hannah Wren, Rédaction Zendesk

Dernière mise à jour 31 mars 2025

Qu’est-ce que la transparence de l’IA ?

La transparence permet de comprendre comment les systèmes d’IA prennent des décisions, pourquoi ils produisent tels ou tels résultats et quelles données ils utilisent. En d’autres termes, la transparence de l’IA revient à ouvrir une fenêtre sur les rouages de l’IA pour cerner le fonctionnement de ces outils et garantir une utilisation fiable.

Nous utilisons l’intelligence artificielle (IA) plus que nous ne le pensons : certains d’entre nous parlent avec Siri ou Alexa tous les jours. Alors que nous continuons à en apprendre davantage sur l’impact de l’IA, les entreprises doivent garder à l’esprit la transparence de l’IA, en particulier lorsqu’il est question de l’expérience client (CX).

Reprenant les faits et les chiffres de notre rapport CX Trends 2025, ce guide explique toute l’importance de l’IA transparente, mais aussi ses exigences et les réglementations applicables, ses avantages, ses défis, ses bonnes pratiques et plus encore.

Au sommaire :

- Pourquoi la transparence de l’IA est-elle importante ?

- Les exigences pour la transparence de l’IA

- Les niveaux de transparence de l’IA

- Les réglementations et les normes pour la transparence de l’IA

- Les avantages de la transparence de l’IA

- Les défis de la transparence dans l’IA (et comment les relever)

- Les bonnes pratiques pour la transparence de l’IA

- Exemples d’entreprises pratiquant l’IA transparente

- Questions fréquentes

- Quel avenir pour la transparence de l’IA ?

Pourquoi la transparence de l’IA est-elle importante ?

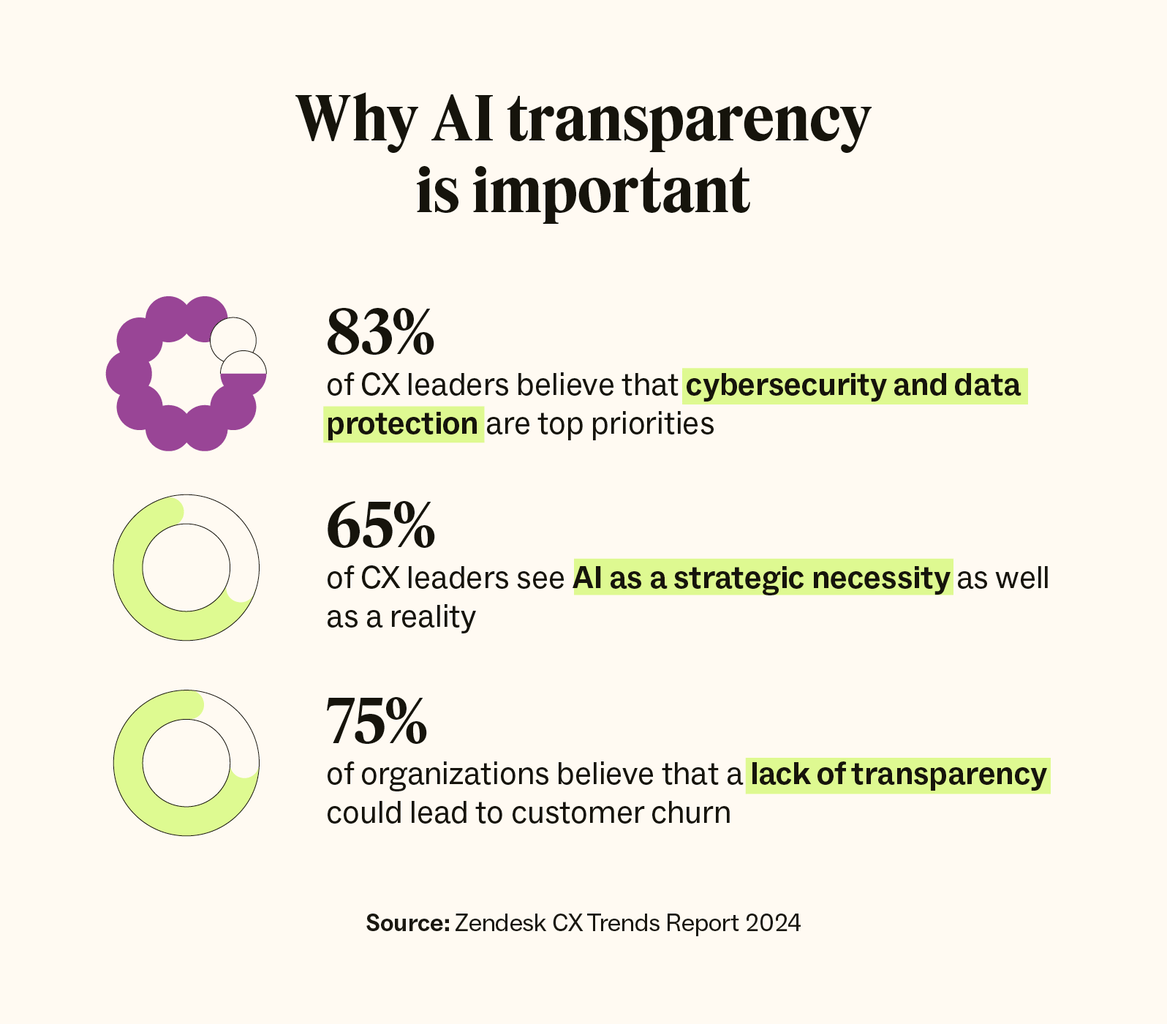

Pour simplifier, la transparence est importante, car elle permet d’expliquer clairement pourquoi l’IA produit ses résultats. Elle aide à comprendre les raisons qui sous-tendent les décisions et les actions de l’IA et permet ainsi de contrôler leur équité et leur fiabilité. Selon notre rapport CX Trends, 65 % des responsables CX considèrent l’IA comme une nécessité stratégique, ce qui fait de la transparence de l’IA un élément crucial à prendre en compte.

Faire preuve de transparence sur les données qui alimentent les modèles d’IA et leurs décisions sera un élément déterminant pour établir et maintenir la confiance avec les clients.Rapport CX Trends 2025 de Zendesk

La transparence de l’IA implique de comprendre ses implications éthiques, juridiques et sociétales et son impact positif sur la confiance des utilisateurs et des parties prenantes. Selon notre rapport CX Trends, 75 % des sociétés estiment qu’un manque de transparence pourrait entraîner une augmentation du taux d’attrition des clients. Dans un monde où les fournisseurs d’IA en tant que service (AIaaS) rendent l’IA plus accessible aux entreprises, il est plus important que jamais de garantir sa transparence.

Les implications éthiques de l’IA consistent à s’assurer que l’IA se comporte de manière équitable et responsable. Les biais des modèles d’IA peuvent entraîner une discrimination involontaire à l’encontre de certains groupes de personnes. Par exemple, l’utilisation de l’IA sur le lieu de travail peut faciliter le processus d’embauche, mais risque aussi de favoriser involontairement certains groupes par rapport à d’autres sur la base de facteurs non pertinents, tels que le sexe ou l’origine. L’IA transparente permet de réduire les biais afin d’obtenir des résultats équitables dans le monde professionnel.

Les implications juridiques de l’IA imposent de veiller à ce que les systèmes respectent les lois en vigueur. Par exemple, si un logiciel basé sur l’IA recueille des informations personnelles sans le consentement approprié, il peut contrevenir aux lois sur la protection de la vie privée. La création de règles qui mettent l’accent sur la transparence de l’IA peut garantir le respect des exigences légales.

Les implications sociétales de l’IA imposent de comprendre comment l’IA affecte la vie quotidienne des individus et de la société dans son ensemble. Par exemple, l’utilisation de l’IA dans les soins de santé peut aider les médecins à établir plus rapidement des diagnostics précis ou à proposer des traitements personnalisés. Toutefois, des questions relatives à l’équité de l’accès à cette technologie peuvent se poser, en raison de son coût.

Les exigences pour la transparence de l’IA

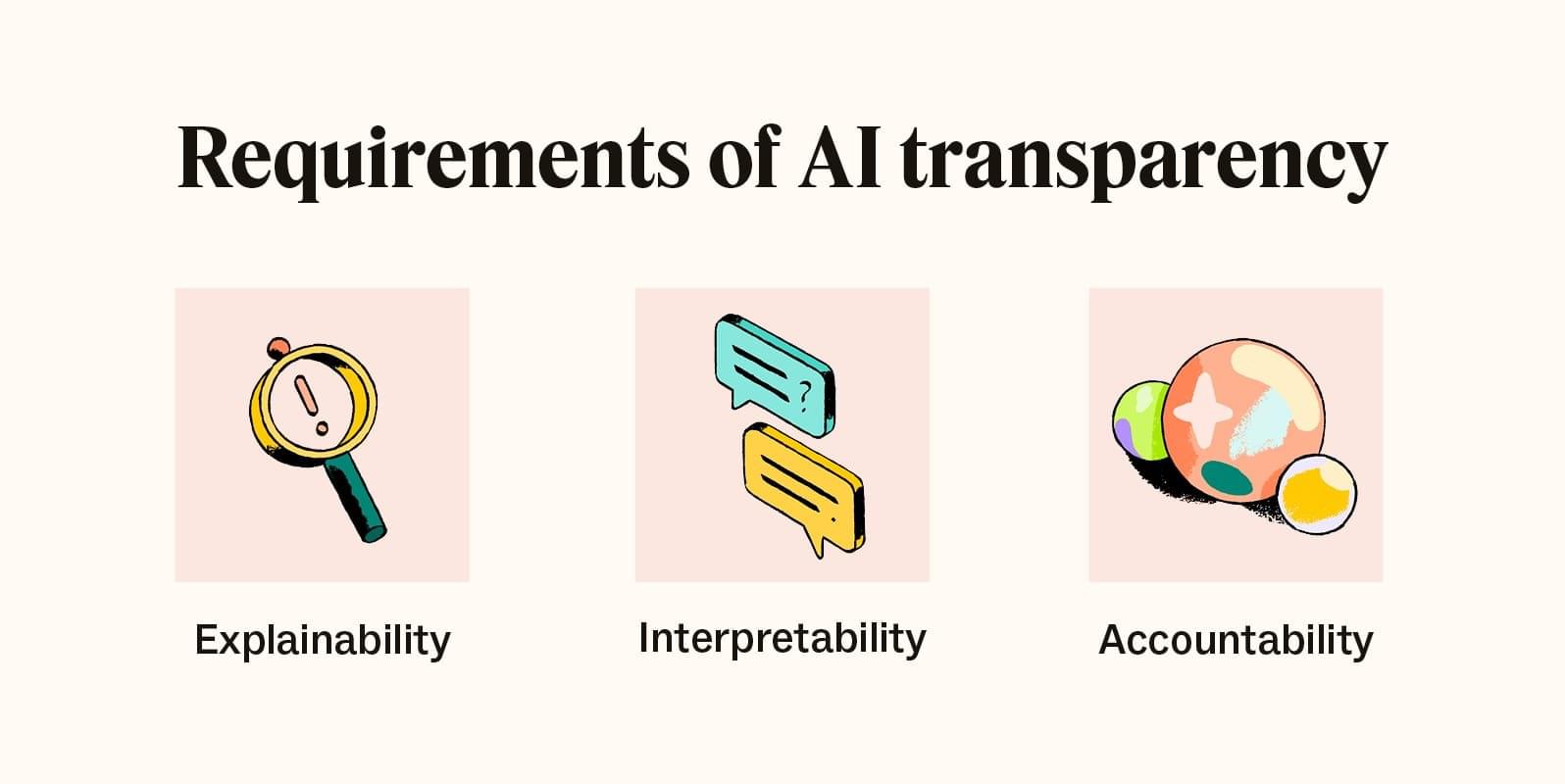

L’IA transparente doit répondre à trois exigences essentielles : l’explicabilité, l’interprétabilité et la responsabilité. Voyons ce qu’elles signifient et leur lien avec les données d’entraînement, les algorithmes et la prise de décision avec l’IA.

Explicabilité

L’IA explicable (ou XAI) désigne la capacité d’un système d’IA à expliquer facilement ses décisions et ses actions. Par exemple, si un client demande à un chatbot de lui recommander des produits, un système d’IA explicable pourrait fournir des détails tels que :

« Nous pensons que ce produit vous plaira, compte tenu de votre historique d’achat et de vos préférences. »

« Nous vous recommandons ce produit sur la base de vos commentaires positifs sur des articles similaires. »

Des explications claires permettent au client de comprendre le processus de prise de décision de l’IA. Il est ainsi plus en confiance, car il comprend ce qui se cache derrière les réponses de l’IA. Ce concept peut également être qualifié d’IA responsable, d’IA digne de confiance ou de boîte blanche.

À l’autre extrémité du spectre, on trouve les boîtes noires. Ces modèles d’IA sont complexes et fournissent des résultats sans expliquer clairement comment ils les ont obtenus. Ce manque de transparence empêche les utilisateurs de comprendre les processus décisionnels de l’IA, ce qui entraîne un manque de confiance dans les informations fournies.

Interprétabilité

L’interprétabilité dans l’IA se concentre sur la compréhension humaine du fonctionnement et du comportement d’un modèle d’IA. Alors que la XAI se focalise sur une explication claire des résultats, l’interprétabilité se concentre sur les processus internes (comme les relations entre les entrées et les sorties) pour comprendre les prédictions ou les décisions du système.

Reprenons le même scénario que précédemment, dans lequel un client demande à un chatbot de lui suggérer des produits. Un système d’IA interprétable peut expliquer qu’il utilise un modèle par arborescence pour décider d’une recommandation.

Responsabilité

Cette exigence vise à garantir que les systèmes d’IA sont tenus responsables de leurs actions et de leurs décisions. Avec le machine learning, l’IA peut apprendre de ses erreurs et s’améliorer au fil du temps. De leur côté, les entreprises doivent prendre les mesures correctives appropriées pour éviter que des erreurs similaires ne se reproduisent à l’avenir.

Supposons qu’un chatbot basé sur IA recommande par erreur un article qui n’est plus en stock. Le client tente d’acheter ce produit et voit qu’il n’est plus disponible, ce qui entraîne une certaine frustration. Le commerçant présente ses excuses et met en place une étape de validation humaine pour les informations critiques sur les produits que les bots souhaitent communiquer aux clients.

Cet exemple de prise de responsabilité en lien avec l’IA dans le service client montre comment l’entreprise a assumé la responsabilité de l’erreur, a défini les étapes pour la corriger et a mis en œuvre des mesures préventives. Votre organisation doit aussi procéder à des audits réguliers des systèmes d’IA afin d’identifier et d’éliminer les préjugés, de garantir des résultats équitables et non discriminatoires, et de favoriser la transparence de l’IA.

Les niveaux de transparence de l’IA

Il y a trois niveaux de transparence de l’IA à l’échelle du système, des utilisateurs et de l’impact global. Les voici :

Transparence algorithmique

Transparence des interactions

Transparence sociale

La transparence algorithmique se concentre sur l’explication de la logique, des processus et des algorithmes utilisés par les systèmes d’IA. Elle renseigne sur les types d’algorithmes d’IA, tels que les modèles de machine learning, les arbres de décision (modèles de type logigramme), les réseaux neuronaux (modèles de calcul) et bien d’autres encore. Elle détaille également la façon dont les systèmes traitent les données et prennent des décisions, et tous les facteurs qui influencent ces choix. Ce niveau de transparence rend le fonctionnement interne des modèles d’IA plus compréhensible pour les utilisateurs et les parties prenantes.

La transparence des interactions concerne la communication et les échanges entre les utilisateurs et les systèmes d’IA. Il s’agit de rendre les échanges plus transparents et compréhensibles. Les entreprises peuvent y parvenir en créant une interface qui explique le fonctionnement de son système d’IA et ce que les utilisateurs peuvent attendre de leurs interactions.

La transparence sociale va au-delà des aspects techniques et se concentre sur l’impact plus large des systèmes d’IA sur la société dans son ensemble. Ce niveau de transparence aborde les implications éthiques et sociétales du déploiement de l’IA, y compris les biais potentiels, l’équité et les exigences en matière de protection de la confidentialité.

Les réglementations et les normes pour la transparence de l’IA

L’intelligence artificielle étant une technologie récente, la réglementation sur la transparence de l’IA a rapidement évolué pour répondre aux enjeux éthiques, juridiques et sociétaux. Voici quelques normes clés qui contribuent à régir l’intelligence artificielle :

- Le Règlement général sur la protection des données (RGPD) : établi par l’Union européenne, il comprend des dispositions relatives à la protection des données, à la confidentialité, au consentement et à la transparence.

- Les principes sur l’IA de l’Organisation de coopération et de développement économiques (OCDE) : un ensemble de principes fondés sur des valeurs qui promeuvent l’utilisation fiable, transparente, explicable, responsable et sûre de l’IA.

- Le framework de responsabilité de l’IA du Government Accountability Office (GAO) : un cadre américain qui définit les responsabilités et les obligations des systèmes d’IA pour garantir la transparence des résultats générés.

- La législation sur l’intelligence artificielle de l’UE : une loi proposée par la Commission européenne qui vise à réglementer le développement des systèmes d’IA dans l’UE.

Ces réglementations peuvent normaliser l’utilisation et le développement de l’IA, au niveau local comme mondial. Les notions de transparence, d’enjeux éthiques et de responsabilité rendent les systèmes d’IA plus clairs et plus fiables.

Les avantages de la transparence de l’IA

L’IA transparente offre de nombreux avantages aux entreprises sur les plans éthique, opérationnel et sociétal. En effet, elle permet de :

- Gagner la confiance des utilisateurs, des clients et des parties prenantes : les utilisateurs, les clients et les parties prenantes sont plus enclins à faire confiance aux technologies d’IA et aux entreprises qui utilisent un service d’assistance basé sur l’IA lorsqu’ils comprennent le fonctionnement de ces systèmes et ont la certitude qu’ils opèrent de manière équitable et éthique.

- Promouvoir l’utilisation responsable de l’IA : une explication claire des processus d’IA favorise son utilisation responsable et responsabilise les entreprises en cas de biais ou d’erreur.

- Détecter et atténuer les biais et les discriminations : la visibilité sur les sources de données et les algorithmes permet aux développeurs et aux data scientists d’identifier les biais. Cela permet aux entreprises de prendre des mesures proactives pour éliminer les préjugés et garantir des résultats justes et équitables.

- Améliorer les performances de l’IA : les développeurs qui comprennent clairement le fonctionnement des modèles peuvent affiner les algorithmes et les processus de manière plus efficace. Les commentaires recueillis auprès des utilisateurs et les informations tirées des données de performance permettent d’apporter des améliorations continues afin d’accroître la précision et l’efficacité des systèmes d’IA au fil du temps, en particulier pour l’IA au service de l’expérience collaborateur.

- Traiter les enjeux d’ordre éthique : la transparence de l’IA permet aux parties prenantes d’évaluer les implications éthiques des décisions et des actions basées sur l’IA, et de s’assurer que les systèmes d’IA fonctionnent dans le respect des directives éthiques.

L’adoption de la transparence dans l’IA ne renforce pas seulement la fiabilité des systèmes d’IA, mais contribue également à leur utilisation responsable et éthique.

Les tendances de l’IA pour la CX

La mise en œuvre d’outils basés sur l’IA dans les logiciels de service client améliore l’expérience client. Et dans ce domaine, les possibilités sont très nombreuses. Découvrez comment exploiter la puissance de l’IA en suivant le rapport CX Trends 2025 de Zendesk.

Les défis de la transparence dans l’IA (et comment les relever)

Les nombreux avantages de la transparence de l’IA s’accompagnent de quelques défis. Ceux-ci peuvent toutefois être gérés et minimisés de manière efficace.

Préserver la sécurité des données

Garantir la confidentialité des données clients tout en maintenant la transparence s’apparente parfois à un numéro d’équilibriste. En effet, le partage de détails sur les données employées dans les outils d’IA peut mettre en péril leur protection. Selon notre rapport CX Trends, 83 % des responsables CX déclarent que la protection des données et la cybersécurité sont des priorités absolues dans leur stratégie de service client.

Comment relever ce défi :

Désignez au moins une personne au sein de l’équipe dont la responsabilité première sera la protection des données. Brandon Tidd, architecte principal de Zendesk chez 729 Solutions, explique que « les responsables CX doivent réfléchir de façon critique à leurs points d’entrée et de sortie, et préparer activement des scénarios où un acteur malveillant pourrait tenter de compromettre les systèmes ».

Expliquer les modèles d’IA complexes

Certains modèles d’IA, en particulier ceux qui utilisent l’apprentissage profond ou les réseaux neuronaux, peuvent être difficiles à expliquer en termes simples. Résultat ? Les utilisateurs peinent à comprendre les processus complexes de prise de décision et d’automatisation intelligente des modèles d’IA.

Comment relever ce défi :

Élaborez des visuels ou des diagrammes simplifiés pour illustrer le fonctionnement des modèles d’IA complexes. Choisissez un logiciel d’IA doté d’une interface pratique qui livre des explications faciles à suivre, sans jargon technique.

Maintenir la transparence quand les modèles d’IA évoluent

Les modèles d’IA s’affinant au fil du temps, il devient de plus en plus difficile de maintenir la transparence. Les mises à jour ou les modifications apportées aux systèmes d’IA ou leur réentraînement sur de nouveaux ensembles de données peuvent modifier leurs processus de prise de décision, ce qui peut rendre difficile le maintien d’une transparence cohérente.

Comment relever ce défi :

Établissez un processus de documentation complet pour suivre les changements apportés à un écosystème d’IA, comme ses algorithmes et ses données. Afin que les parties prenantes soient informées de ces mises à jour et de leurs éventuelles implications, générez des rapports de transparence réguliers faisant état de tous les changements.

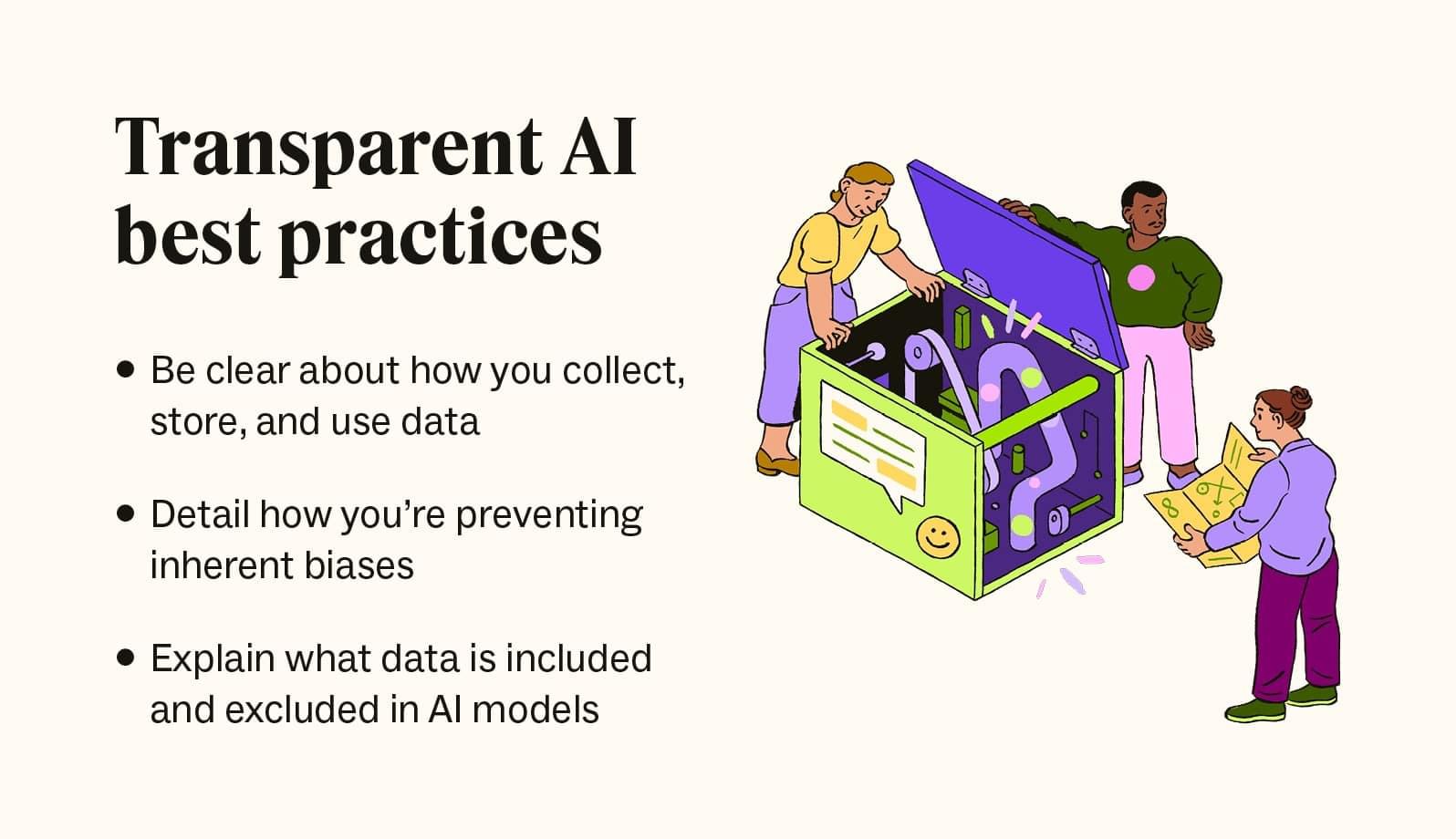

Les bonnes pratiques pour la transparence de l’IA

L’intégration des bonnes pratiques en matière de transparence de l’IA contribue à favoriser la responsabilité et la confiance entre les développeurs d’IA, les entreprises et les utilisateurs. Une communication claire et ouverte sur les pratiques en matière de données, les mesures de prévention des préjugés et les données utilisées (ou non) dans les modèles d’IA peut aider les utilisateurs à se sentir plus confiants dans l’utilisation des technologies d’IA. Voici quelques bonnes pratiques pour garantir la transparence de l’IA.

Expliquer clairement aux clients comment leurs données sont collectées, stockées et utilisées

Fournissez à vos clients des explications transparentes et compréhensibles sur la collecte, le stockage et l’utilisation de leurs données par les systèmes d’IA. Définissez clairement les politiques de protection de la confidentialité en précisant le type de données collectées, l’objectif de la collecte, les méthodes de stockage et l’utilisation qui est faite des données dans les systèmes d’IA Protéger la confidentialité des clients implique en premier lieu d’obtenir le consentement explicite des utilisateurs avant de collecter ou d’utiliser leurs données à des fins d’exploitation par l’IA.

Détailler la manière dont vous prévenez les biais inhérents à votre système

Effectuez des évaluations régulières pour identifier et éliminer les biais de votre logiciel d’IA. Communiquez sur les méthodes utilisées pour prévenir et traiter les biais dans les modèles d’IA pour rassurer les utilisateurs sur les mesures prises pour renforcer l’équité. Tenez un registre sur la détection des préjugés, l’évaluation et les processus afin de démontrer un engagement en faveur de la transparence pour les clients et de la prévention des discriminations.

Expliquer quelles données sont incluses et exclues dans les modèles d’IA

Définissez les types de données incluses et exclues dans vos modèles d’IA et communiquez clairement à ce sujet. Expliquez la méthode de sélection des données utilisées dans l’entraînement de l’IA afin d’aider les utilisateurs à comprendre les limites et les capacités du modèle. Évitez d’inclure des données sensibles ou discriminatoires qui pourraient donner lieu à des biais ou porter atteinte au droit à la vie privée.

Exemples d’entreprises pratiquant l’IA transparente

Voici quelques exemples d’entreprises qui mettent en œuvre des initiatives transparentes en matière d’IA. Leurs efforts pour maintenir et promouvoir une IA responsable les aident à gagner la confiance des clients au quotidien.

Zendesk

Chez Zendesk, nous créons un logiciel d’expérience client qui permet aux utilisateurs d’améliorer leur assistance grâce à des outils d’IA et de machine learning comme l’IA générative et les chatbots basés sur l’IA. Zendesk AI met l’accent sur l’explicabilité en fournissant des informations sur le fonctionnement de ses outils basés sur l’intelligence artificielle et sur la manière dont les décisions sont prises par l’IA.

Zendesk propose également des ressources pédagogiques et de la documentation pour aider les utilisateurs à comprendre l’intégration de l’IA dans les logiciels de service client, les enjeux éthiques de l’IA dans la CX et son impact sur les interactions avec les clients.

Lush

Le détaillant de produits cosmétiques Lush ne cache pas son utilisation éthique de l’IA dans ses activités commerciales. L’entreprise est transparente sur le fait qu’elle n’utilise pas de systèmes de notation sociale ou de technologies susceptibles de porter atteinte à la vie privée ou à l’autonomie des clients. Lush s’engage dans des discussions publiques et partage sa position sur les pratiques éthiques en matière d’IA par le biais de ses communications et de ses canaux de médias sociaux.

OpenAI

OpenAI, un laboratoire de recherche en IA connu pour ses applications d’IA générative ChatGPT et Dall-E, publie régulièrement des documents de recherche et des résultats qui donnent un aperçu de ses avancées en matière d’IA.

OpenAI est transparente quant à ses objectifs, ses directives éthiques et l’impact sociétal potentiel de l’IA grâce à cette documentation fournie. L’entreprise encourage la collaboration dans la communauté de l’IA au sens large en favorisant la transparence et le partage des connaissances sur le développement de l’IA.

65 % des responsables CX voient l’IA comme une nécessité stratégique réelle.Rapport CX Trends de Zendesk

Questions fréquentes

Quel avenir pour la transparence de l’IA ?

L’intelligence artificielle continue d’évoluer et de progresser, tout comme sa transparence. S’il est difficile de prédire exactement à quoi ressemblera l’avenir de la transparence de l’IA, sa trajectoire devrait être rythmée par différentes attentes et tendances.

Il sera notamment question de développer de meilleurs outils pour expliquer les modèles d’IA complexes afin que les utilisateurs puissent comprendre le processus de prise de décisions de l’IA, ce qui contribuera à accroître la confiance et la facilité d’utilisation.

L’accent sera également mis sur les réglementations en matière d’IA et les considérations éthiques. Il sera ainsi plus facile pour les entreprises de mettre en œuvre des pratiques normalisées pour la transparence de l’IA qui traitent des préjugés, de l’équité et des enjeux de protection de la confidentialité pour créer des systèmes d’IA encore plus responsables.